Introduction

La donnée, le flux et leur circulation structurent aujourd’hui l’ensemble des systèmes et des processus au sein de toute entreprise engagée dans une transformation numérique avancée. La définition du flux de données ne se limite plus à un simple transfert d’information entre une source et une destination : elle englobe un véritable processus de traitement des données, intégrant la collecte, la transformation, le stockage, l’analyse et la diffusion dans un système informatique complexe. Un flux de données efficace repose sur une architecture robuste, capable d’assurer une circulation fluide entre les différentes applications, plateformes, bases de données et utilisateurs, tout en respectant les exigences de sécurité, de confidentialité et de conformité réglementaire.

Dans ce contexte, chaque flux de données constitue un élément clé du workflow données, reliant des entités internes et externes via des mécanismes d’intégration de données, souvent basés sur des processus ETL (Extract, Transform, Load) ou des architectures modernes comme le data lakehouse. Ces flux permettent de structurer la gestion des données, d’alimenter les outils de business intelligence, d’analyse commerciale et d’intelligence artificielle, et de soutenir la prise de décision en temps réel. La cartographie des flux, à travers des diagrammes de flux de données (DFD), des modèles UML ou des diagrammes de contexte, offre une représentation visuelle essentielle pour comprendre le chemin emprunté par la donnée, depuis son origine jusqu’à son stockage ou son exploitation.

Dans un environnement où la gestion des flux impacte directement la performance, la qualité des données et l’expérience client, les enjeux sont majeurs. Une mauvaise gestion du flux peut entraîner des erreurs, des problèmes de conformité, des failles de sécurité, ou encore une dégradation de l’efficacité opérationnelle. À l’inverse, une optimisation des flux de données permet d’améliorer la coordination des processus métier, de fluidifier les flux de travail, de réduire les coûts et de renforcer la confiance dans les systèmes d’information. Chaque niveau de flux, qu’il soit logique, physique ou alternatif, doit être pensé dans une logique d’architecture data cohérente, intégrant les contraintes techniques, organisationnelles et stratégiques.

Aujourd’hui, les outils de gestion des flux de données jouent un rôle central dans cette dynamique. Les logiciels de traitement, les plateformes de flux de données, ainsi que les solutions d’intégration permettent de créer, modifier, analyser et optimiser les flux au sein d’un espace de travail numérique unifié. Ces outils facilitent également la mise en œuvre de stratégies de gestion des données en temps réel, essentielles pour répondre aux besoins des utilisateurs, des clients et des partenaires. Dans cette logique, les solutions modernes comme les plateformes low-code et BPM, à l’image de Softyflow, permettent de cartographier, automatiser et piloter les flux de données et les processus métier sans complexité excessive, tout en garantissant une forte capacité d’adaptation.

Ainsi, le flux de données ne se résume pas à un simple mécanisme technique : il constitue un levier stratégique au cœur de la gestion des systèmes d’information, de la transformation des données et de l’innovation. Comprendre la manière dont les données circulent, sont traitées, analysées et utilisées permet aux entreprises d’atteindre une meilleure efficacité, d’optimiser leurs processus de travail et de renforcer leur position sur un marché de plus en plus orienté data-driven. Ce guide propose d’explorer en profondeur les diagrammes de flux, les types de flux de données, les méthodes d’optimisation et les outils indispensables pour construire une architecture de données performante, évolutive et sécurisée.

Qu’est-ce qu’un flux de données ?

Pour comprendre pleinement ce qu’est un flux de données, il faut le visualiser comme un réseau complexe de canaux par lesquels l’information transite. La définition d’un flux de données ne se limite pas à un simple point A vers un point B. Il s’agit d’un processus dynamique et continu qui implique de multiples acteurs, systèmes et étapes de transformation.

Lorsqu’une donnée est générée à la source (par exemple, lors d’une transaction client sur un site web ou via un capteur IoT), elle est souvent brute et non structurée. Le traitement des données intervient alors pour nettoyer, formater et enrichir cette information afin de la rendre exploitable. Ce processus peut inclure des opérations de validation, de filtrage, d’agrégation et de calcul.

Un flux de données efficace est conçu pour minimiser la latence et maximiser la fiabilité. Il doit être capable de gérer des volumes importants d’informations sans compromettre les performances du système global. De plus, la sécurité et la confidentialité sont des éléments cruciaux. Les données sensibles doivent être protégées tout au long de leur parcours, en respectant les réglementations en vigueur telles que le RGPD. Cela implique la mise en place de politiques de contrôle d’accès, de chiffrement et de traçabilité.

En résumé, un flux de données est l’orchestration intelligente de la circulation de l’information, garantissant que chaque utilisateur et chaque application dispose des données nécessaires, au bon format et au moment opportun, pour accomplir ses tâches avec efficacité.

Un flux de données, par définition, représente le chemin emprunté par l’information depuis sa source jusqu’à sa destination finale au sein d’un système informatique. Il englobe toutes les étapes de traitement des données, de la collecte brute à la transformation, jusqu’au stockage dans une base de données ou un data lakehouse. Un flux de données efficace garantit que l’information pertinente est disponible au bon moment, pour le bon utilisateur ou la bonne application. La gestion de ce flux implique de définir des règles claires de circulation, de sécurité et de confidentialité, assurant ainsi la qualité des données tout au long de leur cycle de vie. Une gestion efficace des flux de données constitue un pilier essentiel de la data governance, en garantissant qualité, sécurité et conformité tout au long du cycle de vie de l’information.

Explorez comment Softyflow rend vos flux de données clairs et maîtrisés

Comment créer un diagramme de flux de données ?

La complexité inhérente aux architectures informatiques modernes rend indispensable la modélisation visuelle des processus. C’est là qu’intervient le diagramme de flux de données (DFD). Créer un diagramme de flux est une étape fondamentale dans la conception, l’analyse et l’optimisation de tout système d’information.

La représentation visuelle offerte par un DFD permet de décomposer un système complexe en éléments plus simples et compréhensibles. Elle offre une vue d’ensemble claire de la manière dont les données circulent entre les entités externes (comme les clients ou les partenaires), les processus de traitement (les actions effectuées sur les données) et les espaces de stockage (les bases de données ou les fichiers).

Pour créer un DFD efficace, il est courant d’utiliser des langages de modélisation standardisés, tels que le langage de modélisation unifié UML. Ces standards fournissent un ensemble de symboles et de conventions reconnus par l’ensemble de la communauté informatique, facilitant ainsi la communication et la collaboration entre les différentes parties prenantes d’un projet.

Le processus de création commence généralement par un diagramme de contexte, qui offre une vue de haut niveau du système dans son environnement. Ensuite, ce diagramme est décomposé en diagrammes de flux de niveau inférieur, qui détaillent progressivement les processus internes. Cette approche hiérarchique permet de cartographier le système avec le niveau de granularité souhaité, allant d’une vue globale à une description technique précise.

Un modèle de diagramme bien structuré est un outil inestimable pour identifier les inefficacités, les redondances et les points de défaillance potentiels au sein d’un flux de données. Il sert également de documentation de référence pour les équipes de développement et de maintenance.

Pour visualiser et comprendre ces mouvements complexes, il est essentiel de créer un diagramme de flux (DFD). La représentation visuelle offerte par ces diagrammes de flux permet de cartographier les processus métier et d’identifier les interactions entre les différentes entités externes, les processus de traitement et les espaces de stockage. Créer un DFD implique l’utilisation de symboles standardisés, souvent inspirés du langage de modélisation unifié (UML), pour illustrer la logique de circulation. Un modèle de diagramme bien conçu sert de point de départ pour toute analyse du flux, facilitant la communication entre les équipes techniques et métiers.

À quoi sert un flux de données ?

L’importance d’un flux de données bien structuré ne peut être sous-estimée. L’utilisation d’un flux de données optimisé a un impact direct et mesurable sur l’efficacité opérationnelle et la rentabilité d’une entreprise.

L’analyse du flux permet aux organisations de comprendre précisément comment l’information est utilisée et partagée en interne. Cette visibilité est essentielle pour identifier les goulots d’étranglement qui ralentissent les processus métier. Par exemple, si une étape de validation manuelle retarde systématiquement le traitement d’une commande, l’analyse du flux mettra en évidence ce problème, permettant ainsi de mettre en place une solution automatisée.

Une gestion des données rigoureuse, facilitée par des flux bien définis, garantit également la qualité et la cohérence de l’information à travers toute l’organisation. Lorsque tous les services s’appuient sur une source de vérité unique et fiable, les erreurs de communication et les décisions basées sur des données erronées sont considérablement réduites.

De plus, dans le contexte actuel de la business intelligence et de l’analyse avancée, les flux de données sont le carburant qui alimente les tableaux de bord, les rapports et les modèles prédictifs. Sans une circulation fluide et continue de l’information, il est impossible de tirer parti des technologies d’intelligence artificielle et d’apprentissage automatique pour anticiper les tendances du marché et optimiser la stratégie de l’entreprise.

Enfin, un flux de données efficace est un atout majeur pour la gestion de la relation client. En consolidant les données provenant de multiples points de contact (site web, service client, réseaux sociaux), les entreprises peuvent offrir une expérience client personnalisée et réactive, renforçant ainsi la fidélité et la satisfaction.

L’utilisation d’un flux de données structuré est fondamentale pour l’efficacité opérationnelle d’une organisation. L’analyse du flux permet d’identifier les goulots d’étranglement, d’optimiser les ressources et d’améliorer la gestion des données globale. En assurant une circulation fluide de l’information, les entreprises peuvent accélérer leur prise de décision, renforcer leur relation client et garantir la conformité aux réglementations en vigueur. Un flux bien géré est également le socle de la business intelligence et de l’apprentissage automatique, fournissant les données nécessaires pour alimenter les tableaux de bord et les modèles prédictifs.

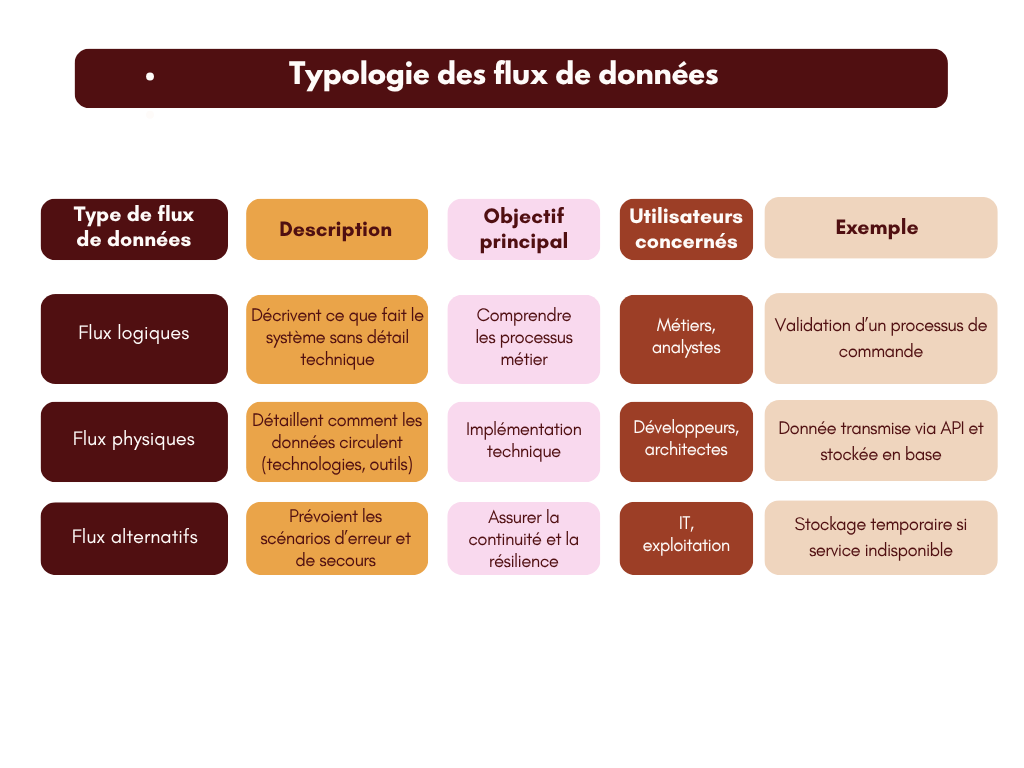

Quels sont les types de flux de données ?

Pour concevoir et gérer efficacement une architecture d’information, il est crucial de comprendre les différents types de flux de données. Chaque type offre une perspective unique sur le système et répond à des objectifs spécifiques d’analyse et de conception.

Les flux de données logiques se concentrent sur l’aspect fonctionnel du système. Ils décrivent ce que le système doit faire, indépendamment de la manière dont il sera implémenté techniquement. Un DFD logique met en évidence les processus métier, les données requises pour chaque processus et les règles de gestion applicables. Cette vue est particulièrement utile lors de la phase de recueil des besoins, car elle permet aux utilisateurs métiers de valider la logique du système sans se perdre dans des détails techniques complexes.

À l’inverse, les flux de données physiques détaillent l’implémentation technique du système. Ils décrivent comment les données circulent concrètement, en spécifiant les logiciels, le matériel, les réseaux et les bases de données impliqués. Un DFD physique montre, par exemple, qu’une donnée est transférée via une API REST, stockée dans une base de données relationnelle spécifique et traitée par un serveur particulier. Cette vue est indispensable pour les architectes et les développeurs chargés de la mise en œuvre et de la maintenance du système.

Outre cette distinction fondamentale, il est également important de considérer les flux de données alternatifs. Dans tout système informatique, des erreurs et des exceptions peuvent survenir (panne de serveur, perte de connexion, données invalides). Les flux alternatifs définissent les chemins de secours et les procédures de traitement des erreurs pour garantir la résilience du système. Par exemple, si un service de paiement externe est indisponible, un flux alternatif peut prévoir de stocker temporairement la transaction et de la réessayer ultérieurement, évitant ainsi une interruption de service pour l’utilisateur.

Il existe plusieurs types de flux de données, chacun répondant à des besoins spécifiques d’architecture et d’analyse. Les flux de données logiques se concentrent sur ce qui se passe, décrivant les processus métier indépendamment de la technologie utilisée. À l’inverse, les flux de données physiques détaillent comment les données circulent, incluant les logiciels, le matériel et les bases de données impliqués. On distingue également les flux de données alternatifs, qui prévoient des chemins de secours en cas d’erreur ou de défaillance du système principal, garantissant ainsi la continuité de l’activité.

Comprenez les flux logiques, physiques et alternatifs grâce à Softyflow

Comment optimiser un flux de données ?

L’optimisation d’un flux de données n’est pas un projet ponctuel, mais une démarche d’amélioration continue. Dans un environnement technologique en constante évolution, les volumes de données augmentent de manière exponentielle et les exigences de performance sont de plus en plus strictes.

L’amélioration du flux repose sur plusieurs piliers fondamentaux. Le premier est l’automatisation. En remplaçant les tâches manuelles répétitives par des processus automatisés, les entreprises peuvent réduire considérablement les délais de traitement et minimiser les risques d’erreur humaine. L’automatisation permet également de libérer des ressources précieuses, qui peuvent être réaffectées à des tâches à plus forte valeur ajoutée.

Le deuxième pilier est l’intégration de solutions de traitement en temps réel. Historiquement, de nombreuses entreprises s’appuyaient sur des traitements par lots (batch processing), où les données étaient collectées et traitées à intervalles réguliers (par exemple, une fois par jour). Aujourd’hui, la nécessité de réagir instantanément aux événements du marché impose l’adoption d’architectures orientées événements (event-driven architectures) et de technologies de streaming de données. Ces approches permettent de traiter l’information au fur et à mesure de sa création, offrant ainsi une visibilité en temps réel sur l’état des opérations.

Une gestion des flux efficace implique également une surveillance proactive. Il est essentiel de mettre en place des outils de monitoring pour suivre les performances du système, détecter les anomalies et identifier les goulots d’étranglement potentiels avant qu’ils n’impactent les utilisateurs. L’analyse des logs et des métriques de performance permet d’ajuster continuellement la configuration du système pour maintenir une efficacité optimale.

Enfin, l’optimisation passe par la modernisation de l’architecture des données. L’adoption de processus ETL (Extract, Transform, Load) modernes, capables de gérer des volumes massifs de données structurées et non structurées, est cruciale. De plus, la migration vers des environnements cloud et l’utilisation de data lakehouses offrent une flexibilité et une évolutivité indispensables pour accompagner la croissance de l’entreprise.

L’optimisation d’un flux de données est un processus continu visant à maximiser l’efficacité et la performance. L’amélioration du flux passe par l’automatisation des tâches répétitives, la réduction des temps de latence et l’intégration de solutions de traitement en temps réel. Une gestion des flux proactive implique de surveiller constamment l’état du système, d’identifier les erreurs potentielles et d’ajuster la logique de circulation en conséquence. L’utilisation de processus ETL (Extract, Transform, Load) modernes et de plateformes d’intégration de données est cruciale pour maintenir un flux de données efficace et évolutif.

Quels outils pour gérer les flux de données ?

Le choix des outils de gestion de flux est une décision stratégique qui conditionne la réussite de toute initiative liée aux données. Le marché propose une vaste gamme de solutions, allant des outils open source spécialisés aux plateformes d’intégration d’entreprise complètes.

Une plateforme de flux de données moderne doit offrir un ensemble complet de fonctionnalités pour couvrir l’ensemble du cycle de vie de la donnée. Cela inclut des connecteurs natifs pour s’intégrer facilement à une multitude de sources de données (bases de données, applications SaaS, API, fichiers plats), des capacités de transformation avancées pour nettoyer et formater l’information, et des outils de surveillance pour garantir la fiabilité des flux.

L’intégration de données est au cœur de ces plateformes. Elle permet de décloisonner l’information en connectant des systèmes hétérogènes qui, autrement, fonctionneraient en silos. Des solutions comme Qlik Cloud, Talend ou Informatica offrent des environnements visuels intuitifs pour concevoir et déployer des pipelines de données complexes sans nécessiter de compétences en programmation approfondies.

Le choix du logiciel de traitement dépendra de plusieurs facteurs, notamment le volume et la vélocité des données, la complexité des transformations requises, le budget disponible et les compétences techniques de l’équipe. Pour les architectures basées sur le cloud, les services gérés proposés par les grands fournisseurs (AWS, Google Cloud, Microsoft Azure) offrent une évolutivité et une facilité de gestion très attractives.

Il est également important de considérer les outils de gouvernance des données, qui permettent de définir et d’appliquer des politiques de qualité, de sécurité et de conformité à travers l’ensemble des flux. Ces outils offrent une visibilité sur le lignage des données (data lineage), permettant de tracer l’origine et les transformations subies par chaque information, ce qui est essentiel pour répondre aux exigences réglementaires et instaurer un climat de confiance autour de la donnée.

Le marché propose une multitude d’outils de gestion de flux pour répondre aux défis complexes de l’ingénierie logicielle et de l’analyse de données. Une plateforme de flux de données robuste doit offrir des fonctionnalités avancées d’intégration de données, de transformation et de surveillance. Des solutions comme Qlik Cloud ou des architectures basées sur des data lakehouses permettent de gérer des volumes massifs d’informations structurées et non structurées. Le choix du logiciel de traitement dépendra des besoins spécifiques de l’entreprise, de son infrastructure existante et de ses objectifs en matière de business intelligence.

Softyflow : L’orchestration low-code au service de vos données

Dans ce paysage technologique complexe, Softyflow s’impose comme une solution incontournable pour la gestion et l’orchestration des flux de données au sein d’un système. Grâce à son approche low-code, la plateforme offre une flexibilité inégalée pour modéliser et adapter les flux de données aux besoins changeants de l’entreprise. Softyflow excelle dans l’automatisation des workflows et du traitement des données, réduisant considérablement les délais de développement et les risques d’erreur. Son intégration fluide avec les applications et systèmes existants permet de décloisonner l’information et d’optimiser la circulation, la transformation et la gouvernance des données. En intégrant les principes du BPM (Business Process Management), Softyflow joue un rôle central dans la gestion des flux et des processus métier, offrant une visibilité totale sur l’état actuel des opérations et facilitant l’amélioration continue.

Quelles erreurs éviter dans les flux de données ?

La mise en place et la gestion de flux de données complexes sont des entreprises périlleuses, jalonnées de nombreux pièges. Connaître et anticiper ces erreurs de flux de données est essentiel pour garantir la pérennité et la fiabilité du système d’information.

L’une des erreurs les plus fréquentes est la négligence de la qualité des données à la source. Si des données erronées, incomplètes ou dupliquées sont injectées dans le flux, elles se propageront à travers tout le système, faussant les analyses et conduisant à des décisions métier désastreuses. Il est impératif de mettre en place des mécanismes de validation et de nettoyage dès la collecte de l’information.

Un autre défi majeur réside dans le manque de documentation et de cartographie des flux existants. Dans de nombreuses organisations, les flux de données se sont développés de manière organique au fil du temps, créant un écheveau complexe et opaque, souvent qualifié de « plat de spaghettis ». Sans une compréhension claire de l’architecture globale, toute modification ou mise à jour du système devient risquée et laborieuse.

Les problèmes de flux sont également souvent liés à des architectures trop rigides et monolithiques. Dans un environnement où les besoins métiers évoluent rapidement, le système d’information doit être capable de s’adapter avec agilité. L’adoption d’architectures basées sur des microservices et des API facilite l’intégration de nouvelles applications et la modification des flux existants sans perturber l’ensemble du système.

Enfin, la sécurité est un aspect trop souvent relégué au second plan. Une gestion des flux efficace doit intégrer la sécurité « by design », c’est-à-dire dès la conception de l’architecture. Cela implique de chiffrer les données en transit et au repos, de mettre en œuvre des mécanismes d’authentification et d’autorisation robustes, et de surveiller en permanence les accès pour détecter toute activité suspecte. Ignorer ces aspects expose l’entreprise à des risques majeurs de fuite de données et de non-conformité réglementaire.

Malgré l’utilisation d’outils performants, la gestion des flux de données comporte des défis inhérents. Parmi les erreurs de flux de données les plus courantes, on trouve le manque de documentation, qui rend difficile la compréhension et la maintenance du système. Les problèmes de flux liés à une mauvaise qualité des données à la source peuvent se propager et fausser l’ensemble des analyses. Il est également crucial d’éviter les architectures trop rigides qui ne peuvent s’adapter aux évolutions des besoins métiers. Une gestion des flux efficace nécessite d’anticiper ces défis de flux de données en mettant en place des stratégies de test rigoureuses, des politiques de sécurité strictes et une surveillance proactive pour détecter et corriger rapidement toute anomalie.

L’importance de la Gouvernance des Données dans la Gestion des Flux

La gouvernance des données est un cadre de politiques, de processus et de technologies qui garantit que les données sont gérées comme un actif stratégique de l’entreprise. Dans le contexte des flux de données, la gouvernance joue un rôle crucial pour assurer la qualité, la sécurité et la conformité de l’information tout au long de son cycle de vie.

Une gouvernance efficace implique de définir clairement les rôles et les responsabilités liés à la gestion des données. Qui est propriétaire de telle ou telle donnée ? Qui est autorisé à y accéder et à la modifier ? Quelles sont les règles de qualité à respecter ? En répondant à ces questions, les entreprises peuvent instaurer un climat de confiance autour de leurs données et s’assurer qu’elles sont utilisées de manière éthique et responsable.

Les outils de gouvernance des données offrent des fonctionnalités avancées pour cartographier les flux, documenter les métadonnées, gérer les accès et surveiller la conformité aux réglementations telles que le RGPD. En intégrant la gouvernance au cœur de leur stratégie de gestion des flux, les organisations peuvent minimiser les risques liés aux données et maximiser leur valeur ajoutée.

Softyflow centralise la gouvernance pour un contrôle total de vos flux de données

L’impact de l’Intelligence Artificielle sur les Flux de Données

L’intelligence artificielle (IA) et l’apprentissage automatique (Machine Learning) transforment radicalement la manière dont les entreprises gèrent et exploitent leurs flux de données. Ces technologies offrent de nouvelles opportunités pour automatiser les processus, optimiser les performances et extraire des insights précieux à partir de volumes massifs d’informations.

L’IA peut être utilisée pour automatiser la classification et le nettoyage des données, réduisant ainsi considérablement les efforts manuels et les risques d’erreur. Elle permet également de détecter des anomalies et des modèles complexes dans les flux de données en temps réel, offrant ainsi une visibilité sans précédent sur l’état des opérations et facilitant la prise de décision proactive.

De plus, l’apprentissage automatique peut être utilisé pour optimiser dynamiquement les flux de données en fonction de l’évolution des conditions du marché et des besoins de l’entreprise. Par exemple, un algorithme de Machine Learning peut analyser les performances d’un réseau de distribution et ajuster automatiquement les itinéraires de livraison pour minimiser les coûts et les délais.

En intégrant l’IA et le Machine Learning à leur architecture de données, les entreprises peuvent créer des flux de données intelligents et adaptatifs, capables de répondre aux défis les plus complexes de l’économie numérique.

Cas d’usage : Optimisation de la Chaîne d’Approvisionnement

Pour illustrer concrètement l’impact d’une gestion efficace des flux de données, prenons l’exemple de l’optimisation de la chaîne d’approvisionnement. Dans ce domaine, la capacité à suivre en temps réel la circulation des marchandises, des informations et des flux financiers est essentielle pour garantir la satisfaction client et la rentabilité de l’entreprise.

Un flux de données optimisé permet de connecter l’ensemble des acteurs de la chaîne d’approvisionnement (fournisseurs, transporteurs, entrepôts, distributeurs) au sein d’une plateforme unique et collaborative. Cette intégration facilite le partage d’informations en temps réel, permettant ainsi d’anticiper les ruptures de stock, d’optimiser les niveaux de stocks et de réduire les délais de livraison.

De plus, l’analyse des données générées par la chaîne d’approvisionnement permet d’identifier les inefficacités et les opportunités d’amélioration. Par exemple, l’analyse des temps de transit peut révéler des goulots d’étranglement sur certains itinéraires, permettant ainsi de renégocier les contrats de transport ou de modifier les schémas logistiques.

En s’appuyant sur des flux de données performants et des outils d’analyse avancés, les entreprises peuvent transformer leur chaîne d’approvisionnement en un véritable avantage concurrentiel, capable de s’adapter rapidement aux fluctuations de la demande et aux perturbations du marché.

Conclusion

La maîtrise des flux de données est un enjeu stratégique majeur pour toute organisation souhaitant tirer parti de son patrimoine informationnel. De la création d’un diagramme de flux à l’optimisation continue des processus, chaque étape requiert une expertise technique et une vision claire des objectifs métiers. En s’appuyant sur des solutions innovantes comme Softyflow et en adoptant les meilleures pratiques de gestion des données, les entreprises peuvent transformer leurs données brutes en un véritable avantage concurrentiel, stimulant l’innovation et garantissant une efficacité opérationnelle durable.