Dans un contexte où chaque entreprise accumule des volumes croissants de donnée, de signaux client, de logs applicatifs, de documents, de transactions et d’informations issues d’outils digitaux, le clustering devient une méthode essentielle pour transformer une base complexe en connaissance exploitable. Cette technique de machine learning permet d’identifier automatiquement un groupe, une classe, une grappe ou une zone homogène au sein d’un jeu de données, sans disposer au départ d’étiquettes de classification. Contrairement à un modèle supervisé qui apprend à partir d’exemples déjà classés, le clustering relève de l’apprentissage automatique non supervisé : il cherche des structures cachées, des similarités, des distances, des centres, des relations et des régularités que l’œil humain ou une analyse statistique classique ne voit pas toujours. Dans cette logique, un Data Hub joue un rôle clé en centralisant et en unifiant les données nécessaires à une analyse de clustering fiable et performante.

La valeur du sujet est donc très concrète. En marketing, le clustering aide à créer une segmentation de marché plus fine et à regrouper des clients selon leur comportement. En data mining, il permet d’explorer une grande base de données, d’identifier des individus proches, de découvrir des catégories émergentes ou de préparer un traitement intelligent avant une étape de modélisation. En science des données, un algorithme de clustering comme k-means, DBSCAN, mean shift, le clustering hiérarchique, spectral clustering ou un modèle de mélange gaussien peut devenir un outil d’aide à la décision, d’optimisation et d’organisation. Cette première étape de cluster analysis peut aussi améliorer la qualité d’un projet de machine learning, car elle donne une représentation graphique, une mesure de similarité, une distance moyenne intra-groupe et des indices d’évaluation comme le score de silhouette, le silhouette coefficient, le Calinski-Harabasz ou le Davies-Bouldin. Cet article expert explique la définition, le fonctionnement, les types de clustering, les méthodes de clustering, les critères pour choisir le nombre de clusters, les applications et la performance, avec des exemples concrets et un regard pratique pour les équipes data, les utilisateurs métiers et les responsables d’innovation.

Qu’est-ce que le clustering ?

Le clustering est une technique d’apprentissage automatique qui consiste à regrouper automatiquement des points de données en ensembles cohérents, appelés clusters, selon leur proximité, leur distance ou leur similarité. Sa définition la plus simple est la suivante : il s’agit d’une méthode de regroupement qui cherche à placer dans un même groupe des observations similaires, tout en séparant les observations différentes dans d’autres groupes. Cette logique est proche de la classification, mais elle ne repose pas sur des classes préexistantes : l’algorithme de clustering découvre lui-même les structures dans les données.

Dans une classification supervisée, un modèle apprend à reconnaître une classe à partir d’un historique déjà annoté, par exemple « client fidèle », « client à risque » ou « transaction frauduleuse ».

Dans le clustering, aucune étiquette n’est fournie au départ. L’algorithme observe les caractéristiques, compare les distances, examine la densité ou la variance, puis crée des groupes similaires. Cette différence est fondamentale : le clustering permet d’apprendre à partir de données brutes, de détecter une structure latente et de produire une organisation utile avant même de définir une règle métier.

| Notion | Rôle dans le clustering | Exemple concret |

| Point de données | Observation individuelle à analyser | Un client, un document, une image, une transaction |

| Distance | Mesure de proximité entre deux points | Distance euclidienne entre profils d’achat |

| Cluster | Groupe d’observations proches | Segment de clients à forte valeur |

| Centre ou centroïde | Moyenne représentative d’un groupe | Profil moyen d’un segment k- means |

| Algorithme de clustering | Méthode de regroupement automatique | k-means, DBSCAN, clustering hiérarchique |

Le clustering est utilisé pour donner du sens à des ensembles complexes. Une équipe data peut l’utiliser pour analyser une base de données client, organiser des documents, identifier des anomalies, construire une carte thermique, préparer une formation de modèle ou réduire la complexité d’un système d’information. La méthode est aussi précieuse lorsqu’un expert humain souhaite comprendre des comportements sans imposer de catégories a priori.

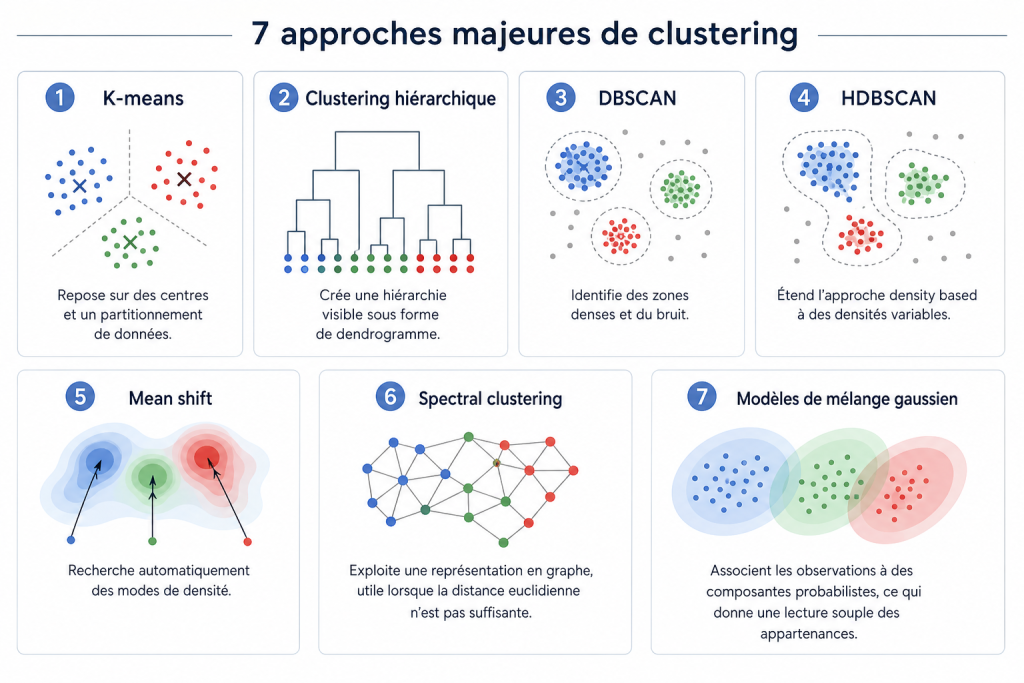

Les 7 méthodes majeures à connaître

Pour analyser efficacement vos données, sept approches dominent la pratique professionnelle. K-means repose sur des centres et un partitionnement de données. Le clustering hiérarchique crée une hiérarchie visible sous forme de dendrogramme. DBSCAN identifie des zones denses et du bruit. HDBSCAN étend l’approche density based à des densités variables. Mean shift recherche automatiquement des modes de densité. Le spectral clustering exploite une représentation en graphe, utile lorsque la distance euclidienne n’est pas suffisante. Enfin, les modèles de mélange gaussien associent les observations à des composantes probabilistes, ce qui donne une lecture souple des appartenances.

Comment fonctionne le clustering ?

Le fonctionnement du clustering repose sur une idée simple : les algorithmes de clustering comparent les points de données entre eux, évaluent leurs similarités, puis cherchent à les regrouper de manière cohérente. Cette technique d’apprentissage est non supervisé, car elle ne demande pas de labels true ni de classes déjà connues. Elle exploite des variables, des caractéristiques ou des représentations numériques pour créer une partition pertinente du jeu de données.

La première étape consiste à préparer les données. Les variables doivent être nettoyées, normalisées et, si nécessaire, transformées. Cette étape est indispensable car beaucoup d’algorithmes reposent sur une mesure de distance. Si une variable a une échelle beaucoup plus grande qu’une autre, elle peut dominer le calcul. Par exemple, dans une base client, le revenu annuel pourrait écraser l’âge, le nombre de visites ou le score de satisfaction si les données ne sont pas standardisées.

Ensuite, le modèle calcule des proximités. Dans k-means, chaque observation est associée au centre le plus proche, puis les centres sont recalculés comme moyenne des points attribués. La documentation scikit-learn rappelle que l’algorithme k-means sépare les échantillons en groupes de variance comparable et minimise l’inertie, c’est-à-dire la somme des carrés intra-cluster. Dans DBSCAN, le fonctionnement est différent : un cluster est une zone de haute densité séparée par des zones de faible densité, avec des paramètres comme eps et min_samples pour définir ce qui est dense.

Le clustering n’est donc pas seulement un calcul. C’est un processus d’analyse. Il combine un objectif métier, une connaissance des données, une méthode algorithmique, des paramètres, une mesure de performance et une interprétation. Un bon projet ne se limite pas à afficher des couleurs sur un graphique : il explique pourquoi les groupes existent, comment les utiliser et quelles décisions ils rendent possibles.

Transformez vos données en groupes intelligents grâce au clustering

Quels sont les types de clustering ?

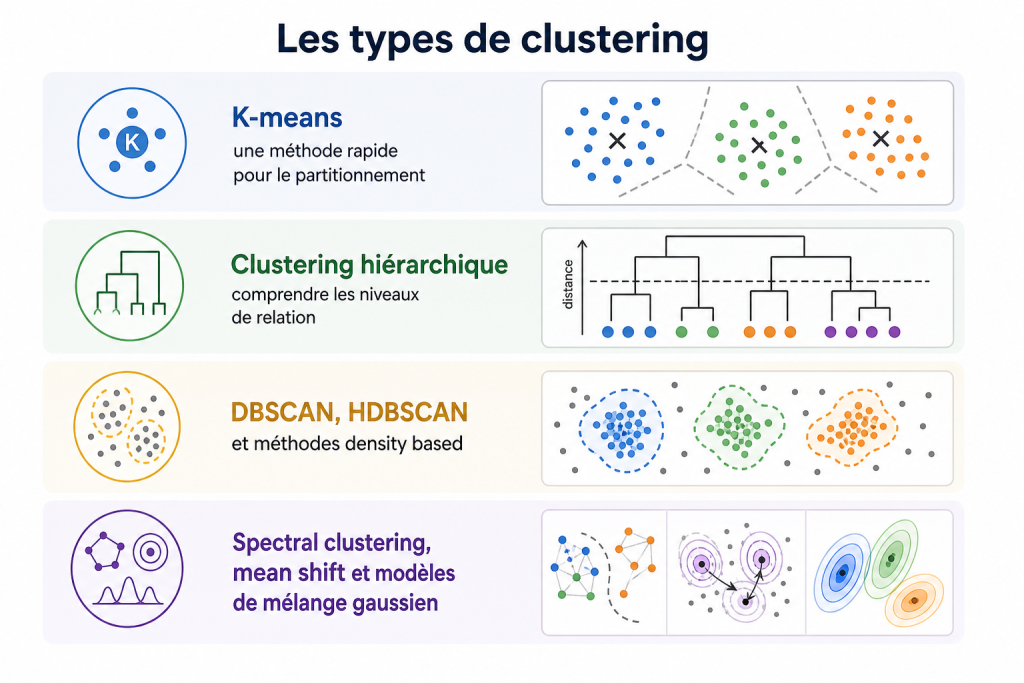

Les types de clustering correspondent aux grandes familles de méthodes de clustering utilisées pour organiser les données. Chaque approche de clustering répond à un besoin différent : certains algorithmes favorisent le partitionnement de données, d’autres la densité, la hiérarchie, la probabilité ou les graphes. Le choix dépend de la taille du jeu de données, de la forme attendue des groupes, du niveau de bruit, du nombre de clusters souhaité et de la manière dont l’entreprise veut exploiter les résultats.

K-means : une méthode rapide pour le partitionnement

K-means est l’une des méthodes les plus utilisées. Elle cherche à créer k groupes autour de centres, appelés centroïdes. Chaque point est associé au centre le plus proche, puis le centre est recalculé comme moyenne des points du groupe. Cette boucle continue jusqu’à stabilisation. L’approche est efficace lorsque les clusters sont plutôt compacts, convexes et de taille comparable. Elle est très utilisée en segmentation client, en compression d’image, en analyse de comportement et en exploration de données.

Son principal avantage est sa simplicité. Son principal risque est qu’il faut choisir le nombre de clusters à l’avance. De plus, k-means peut être sensible aux valeurs extrêmes, à l’initialisation des centres et aux formes non sphériques. L’initialisation k-means++ améliore souvent la stabilité en choisissant des centres initialement plus éloignés.

Clustering hiérarchique : comprendre les niveaux de relation

Le clustering hiérarchique crée une hiérarchie de groupes et la représente souvent sous forme de dendrogramme. Dans une approche ascendante, chaque observation commence dans son propre cluster, puis les groupes les plus proches fusionnent progressivement. La documentation scikit-learn précise que le clustering hiérarchique construit des clusters imbriqués par fusions ou divisions successives, représentés comme un arbre dont la racine regroupe tous les échantillons.

Cette méthode est utile lorsque l’on veut voir différents niveaux d’organisation. Par exemple, une entreprise peut analyser des clients en grands segments, puis en sous-segments plus précis. Elle peut aussi comparer des documents, des produits ou des zones géographiques. Les critères de liaison, comme Ward, complete, average ou single linkage, modifient la manière dont la distance entre groupes est calculée.

DBSCAN, HDBSCAN et méthodes density based

DBSCAN est une méthode density based : elle forme des clusters à partir de zones denses et marque les points isolés comme bruit. Cette approche est particulièrement utile lorsque les groupes ont une forme irrégulière ou lorsque le jeu de données contient des anomalies. Contrairement à k-means, DBSCAN ne nécessite pas de choisir le nombre de clusters à l’avance. Il exige cependant des paramètres de densité, notamment eps et min_samples.

HDBSCAN va plus loin en gérant des densités variables. Il explore différentes échelles de densité et réduit la dépendance à un seul rayon de voisinage, ce qui le rend adapté à des données plus réalistes, où certains groupes sont très compacts et d’autres plus dispersés.

Spectral clustering, mean shift et modèles de mélange gaussien

Le spectral clustering transforme les relations entre points en graphe et exploite cette représentation pour trouver des groupes non linéaires. Il est utile lorsque les frontières entre clusters ne sont pas bien décrites par une distance euclidienne simple. Mean shift recherche des zones de densité maximale sans imposer directement le nombre de clusters ; il peut être pertinent pour des nuages de points ou des tâches de vision. Les modèles de mélange gaussien, eux, décrivent les données comme une combinaison de distributions probabilistes et fournissent une probabilité d’appartenance à chaque groupe.

Comment choisir le nombre de clusters ?

Le nombre de clusters est l’un des paramètres les plus importants à choisir, surtout avec k-means ou toute technique de clustering fondée sur un partitionnement explicite. Une mauvaise valeur de k peut produire des groupes trop grossiers, inutilisables pour l’analyse, ou au contraire des micro-groupes difficiles à interpréter. Le bon nombre dépend de l’objectif, de la structure des données, de la qualité de séparation et de l’optimisation attendue.

Une première approche consiste à tester plusieurs valeurs de k et à observer l’inertie. La méthode du coude cherche le point où l’amélioration devient marginale : si passer de 2 à 3 clusters réduit fortement la distance intra-groupe, mais que passer de 6 à 7 apporte peu, le coude peut indiquer une valeur raisonnable. Cette méthode reste visuelle et doit être complétée par d’autres critères.

Le score de silhouette est souvent plus informatif. Il compare, pour chaque point, la distance moyenne avec les points de son propre groupe et la distance moyenne avec le groupe voisin le plus proche. Un score élevé indique des clusters bien définis. Le silhouette coefficient est donc utile pour choisir le nombre de clusters, notamment avec k-means, car il mesure à la fois la cohésion interne et la séparation externe.

Le Calinski-Harabasz peut également guider le choix. Il compare la dispersion entre clusters à la dispersion à l’intérieur des clusters ; un score plus élevé indique généralement une meilleure structure. Le Davies-Bouldin adopte une logique inverse : plus l’indice est bas, meilleure est la séparation entre les groupes.

| Critère | Se qu’il mesure | Interprétation |

| Inertie k-means | Somme des distances carrées intra-cluster | Plus bas est meilleur, mais non normalisé |

| Méthode du coude | Diminution marginale de l’inertie | Repère visuel pour choisir k |

| Silhouette coefficient | Cohésion et séparation | Plus haut est meilleur |

| Calinski-Harabasz | Ratio dispersion inter/intra | Plus haut est meilleur |

| Davies-Bouldin | Similarité moyenne entre clusters | Plus Bas est meilleur |

Dans la pratique, choisir le nombre de clusters exige aussi un contrôle métier. Un modèle peut suggérer huit groupes, mais si l’équipe marketing ne peut gérer que quatre offres, une solution plus simple peut être préférable. À l’inverse, un analyste scientifique peut conserver davantage de clusters si l’objectif est de découvrir des relations fines ou des catégories rares. Le bon paramètre est donc une combinaison entre calcul, stabilité, interprétabilité et valeur opérationnelle.

Quels sont les avantages du clustering ?

Les avantages du clustering sont nombreux pour l’analyse des données, l’exploration de données, l’organisation d’informations et l’identification de groupes similaires. Son premier intérêt est de rendre visible une structure cachée. Lorsqu’une base contient des milliers ou millions d’observations, il devient difficile pour un expert humain de voir les tendances globales. Le clustering transforme cette masse en segments lisibles, comparables et actionnables.

Le deuxième avantage est l’aide à la décision. En regroupant les clients selon leurs comportements, une entreprise peut adapter ses campagnes marketing, personnaliser une offre, mieux gérer ses ressources et améliorer la relation utilisateur. Dans un contexte industriel, le clustering peut regrouper des machines selon leurs signaux de maintenance. Dans un contexte documentaire, il peut organiser des contenus, détecter des sujets proches ou améliorer un moteur de recherche interne.

Un troisième avantage tient à la préparation de modèles. Le clustering peut servir d’étape intermédiaire dans un pipeline de machine learning. Il peut créer une variable de segment, identifier des anomalies à exclure, réduire la complexité d’un jeu de données ou améliorer la formation d’un modèle supervisé. Il peut également soutenir l’analyse statistique en révélant des groupes homogènes qui méritent une étude séparée.

Exploitez le clustering pour améliorer vos décisions et révéler des tendances cachées

Softyflow, low-code et BPM : accélérer la gestion des projets de clustering

Dans les projets data, l’enjeu n’est pas seulement de lancer un algorithme, mais de coordonner les données, les équipes, les validations, les traitements et les décisions. Softyflow, plateforme low-code, peut jouer un rôle structurant dans l’analyse et l’organisation des données en facilitant la création de processus modulaires autour du traitement intelligent des données. Grâce à une logique visuelle et flexible, une équipe peut automatiser les étapes liées à la collecte, au nettoyage, à la qualification, à la validation et à la diffusion des résultats d’un projet de clustering.

Softyflow s’inscrit aussi dans une logique de logiciel BPM, c’est-à-dire de gestion des workflows métiers. Cette capacité est importante pour relier les analyses de machine learning aux opérations réelles : déclencher une revue lorsqu’un cluster client change, transmettre un segment à une équipe marketing, suivre les demandes d’optimisation ou documenter les paramètres utilisés. La plateforme contribue ainsi à simplifier les projets data, à renforcer la traçabilité et à soutenir l’innovation. Par sa flexibilité, sa modularité et son orientation processus, Softyflow est aussi une solution permettant de gérer et de contribuer à la gestion des projets d’analyse de données et de clustering, depuis l’expérimentation jusqu’à l’industrialisation.

Quelles applications du clustering ?

Les applications du clustering couvrent de nombreux domaines où l’analyse de données, le machine learning et l’intelligence artificielle doivent produire une organisation exploitable. La segmentation client reste l’un des exemples les plus connus. Une entreprise peut regrouper ses clients selon la fréquence d’achat, le panier moyen, la sensibilité au prix, l’engagement digital ou la valeur vie client. Cette approche permet de construire des offres plus pertinentes et d’améliorer la personnalisation.

Dans le marketing, le clustering aide à identifier des profils similaires, à bâtir des campagnes ciblées et à détecter des comportements inhabituels. Dans la banque ou l’assurance, il peut révéler des anomalies, des groupes de risque ou des comportements proches d’une fraude. Dans la santé, il peut regrouper des patients selon des caractéristiques cliniques, biologiques ou comportementales, en soutien à des analyses exploratoires. Dans l’industrie, il peut organiser des séries temporelles de capteurs pour détecter des états de fonctionnement d’une machine.

Le clustering est également utile pour les contenus. Un site web peut regrouper des articles, des ressources de blog ou des documents par sujet. Une équipe support peut analyser des tickets utilisateur pour identifier les thèmes récurrents. Un moteur de recommandation peut rapprocher des objets, des produits, des images ou des textes selon leur similitude. En traitement du langage, les représentations vectorielles permettent de regrouper des phrases ou documents qui parlent du même sujet même s’ils n’utilisent pas exactement les mêmes mots.

Exemples concrets d’utilisation professionnelle

Prenons une base de clients e-commerce. Les variables peuvent inclure le nombre de commandes, la moyenne du panier, la fréquence de visite, le délai depuis le dernier achat, la catégorie préférée et le taux d’ouverture des emails. Un kmean ou k-means peut créer plusieurs clusters : clients premium, acheteurs occasionnels, visiteurs sensibles aux promotions et clients dormants. Chaque cluster devient une ressource stratégique pour adapter la communication.

Dans un autre exemple, une équipe data peut utiliser DBSCAN pour détecter des points atypiques dans des données de géolocalisation. Les zones denses correspondent à des lieux d’activité fréquents, tandis que les points isolés peuvent signaler une anomalie ou un comportement rare. Sur des documents, une classification hiérarchique peut créer un dendrogramme qui révèle les relations entre sujets et aide à construire une taxonomie éditoriale.

Comment évaluer la performance du clustering ?

Pour évaluer la performance du clustering, il faut mesurer la cohérence des groupes, leur séparation, leur stabilité et leur utilité. Contrairement à une classification supervisée, il n’existe pas toujours de labels true pour calculer une précision. L’évaluation combine donc des métriques internes, des métriques externes si une vérité terrain existe, et une validation métier.

Le silhouette coefficient est l’un des indicateurs les plus utilisés. Il mesure pour chaque point la distance moyenne avec les autres points de sa classe et la distance avec le cluster voisin le plus proche. Un score plus élevé correspond à des clusters mieux définis. Il est très pratique pour comparer plusieurs valeurs de k ou plusieurs algorithmes de clustering. Il faut toutefois l’interpréter avec prudence, car il favorise souvent des clusters convexes et peut être moins adapté à des formes density based comme DBSCAN.

L’indice calinski harabasz évalue le rapport entre dispersion inter-clusters et dispersion intra-clusters. Plus le score est élevé, plus les groupes sont généralement séparés et compacts. L’indice davies bouldin, lui, mesure la similarité moyenne entre clusters en comparant la distance entre groupes et leur taille. Plus il est proche de zéro, meilleure est la partition.

L’évaluation doit aussi examiner la stabilité. Si de petites modifications des données ou des paramètres produisent des clusters radicalement différents, la solution est fragile. Il est utile de tester plusieurs échantillons, plusieurs initialisations, plusieurs distances et plusieurs paramètres. Une représentation graphique, une carte thermique, une projection en deux dimensions ou un dendrogramme peuvent aider à contrôler visuellement la cohérence.

Enfin, la meilleure performance n’est pas toujours le meilleur score. Un clustering utile doit être compréhensible, exploitable et relié à une action. Si un groupe n’a pas de signification métier ou ne change aucune décision, son intérêt reste limité. À l’inverse, une partition légèrement moins optimale statistiquement peut être plus précieuse si elle permet à une équipe de lancer une campagne, d’organiser un workflow, de détecter des risques ou d’améliorer un système.

Mesurez la cohérence et la stabilité de vos clusters grâce à Softyflow

Conclusion

Le clustering est une méthode centrale du machine learning non supervisé. Il permet d’analyser une grande variété de données, d’identifier des groupes similaires, de révéler des structures cachées et de transformer une base complexe en informations exploitables. Les sept grandes méthodes présentées — k-means, clustering hiérarchique, DBSCAN, HDBSCAN, mean shift, spectral clustering et modèles de mélange gaussien — offrent des réponses différentes selon la forme des données, la densité, le bruit, le nombre de clusters attendu et le niveau d’interprétation recherché.

Pour réussir un projet de clustering, il faut préparer les données, choisir une approche adaptée, optimiser les paramètres, évaluer la performance et relier les résultats à un objectif métier. Les métriques comme le silhouette coefficient, Calinski-Harabasz et Davies-Bouldin apportent un cadre rigoureux, mais elles doivent être complétées par une analyse humaine et une validation opérationnelle. Dans les organisations modernes, des plateformes comme Softyflow peuvent aussi contribuer à industrialiser les workflows, automatiser le traitement intelligent des données et faciliter la gestion des projets d’analyse de données et de clustering.